京公网安备 11010802034615号

经营许可证编号:京B2-20210330

京公网安备 11010802034615号

经营许可证编号:京B2-20210330

小白学数据分析:怎么做流失分析

最近看了很多关于流失分析的文章,也构建了一些模型,流失这个问题看似有些让人抓不住一根主线来做,这几天也有几个朋友问我"数据分析师"怎么来做流失的分析,但是最近工作变动,外加上很忙,就没有很好的跟他们说说这个问题。说到流失分析,很多人都知道使用决策树算法,C5.0、Chaid、Quest或者贝叶斯,也有用聚类分析的,总的来说流失分析的方法很多,但这些都是技术层面的,也算不上是一个流失模型。

前几天看到一篇文章来讲述怎么分析永恒之塔的流失,方法和过程真的很不错,不过流失分析远比这个还要多,其原因在于,那篇文章中,作者是选取了1-10级的新手作为研究对象,而实际上,流失分析面向的对象不仅仅就是新手(废话,谁都知道!),这句话是句废话,现在看,做数据分析的都明白,然而一旦真的做数据分析,研究流失率时,往往就忽略了我们要对那些人进行流失分析,眉毛胡子一把抓。

早先写过一篇关于流失分析设计的文章,但是后来反映设计的过于复杂和繁琐,没必要这么分析。其实,我觉得很有必要。流失分析不是你信手拈来就开始做你的流失分析的。在之前的文章中,主要设计的是历史用户的流失分析方式,把历史用户的流失分成了留存、沉默、流失、回流、植物等几类情况,实际上这种分类的形式是由玩家的游戏生命进程(生命周期)决定的,原因我觉得有以下几点:

正如文章所言,流失分析很多情况下只是告诉你谁会流失,流失的人有什么特征,而这两点对应的是流失分析的两个方面:

1. 谁会流失->流失用户的预测,告诉你流失的可能;

而流失分析最终的目的是通过这两点,仅仅结合业务分析流失的原因(再好的算法,模型不会告诉你原因),而解决了谁会流失,流失特征,流失的原因,那么就可以进行挽留措施的实施,到此一个完整的流失分析闭环才形成。

形成闭环的原因在于,新的一批用户会继续检验我们的流失分析模型,我们希望在同样的游戏进程时期或者状态下,能够通过不断的修正模型,使之具有普适性。这样的一些模型最后组合起来,就可以比较全面的描述玩家不同的游戏生命进程的流失特征。当然这需要不断的实验和分析,因为用户的质量也是要考虑的。最后,建立在反复使用模型分析的基础上,得到显著性的模型框架。

而这个过程中,值得我们注意的是,往往我们很多时候做的是这其中一小部分,而我们恰恰把这一小部分放大认为是流失分析的全部,比如我们做了40级-50级的流失用户,找出流失用户可能性,流失特征,但是往往忽略做一些挽留的措施,挽留的措施有的是软性的,比如通过活动,奖励等实施,也有通过更改系统设计来弥补,但是这要看你"数据分析师"做的流失分析用户流失的严重程度,换句话说如果这一阶段的流失是一部分客群引起的高流失,而这部分客群不代表我们整体客群(流失客群的特征与之前历史客群在该阶段流失特征不符合,那么这就不是系统设计的因素造成的),此时就不能轻易使用更改系统设计的办法,多数情况下采取软性的手段,帮助用户过度。

然而,回头来看,站在一个高度来看我们是根据了玩家的游戏进程到什么阶段(处于的状态)来确定我们的流失分析对象和方法的。

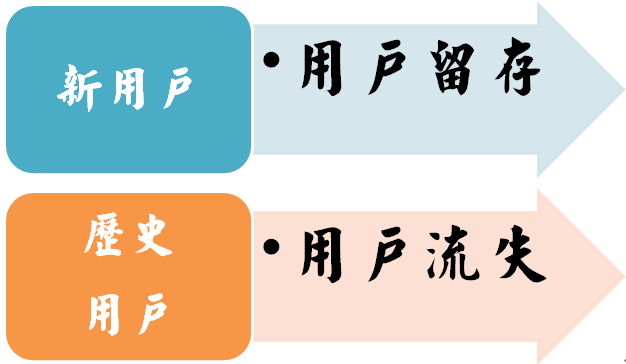

看了永恒之塔的流失分析我发现,之前的针对新手的流失分析没有深入的做过研究,PRARA模型关注的很多也是用户保有留存的问题,可以看得出一批新用户,我们关注更多的是留存问题,而那些历史用户我们"数据分析师"关注的流失问题。

针对用户流失的设计我们"数据分析师"大概有月流失,周流失,沉默,然而我们"数据分析师"在这块的分析远远没有达到一个高度,毕竟我们的收入主体还是来源于这些历史用户,本身来说付费转化,游戏学习成本都很低了,专注这些用户,做好挽留发挥的效益更大。

然而新用户正如文章也提及的情况,新用户对游戏的学习,操控,熟悉还不完全,即使我们获取了信息,流失特征,流失可能性,大概我们想找出来玩家为什么还是会离开难度就会比较大,即使我们有最好的新手体验流程和新手缓冲期,但不能避免的用户流失(当然这不是说新用户的留存、流失分析不重要)。然而反过来当玩家游戏生命周期进入稳定期或者提升期,却面临了很大的流失,那么我们获取流失特征,分析流失可能性,最后做出挽留得到的效益远远大于新手的流失分析。

说了上面这句话大概看到的人会笑,会喷我,补充一句的是,一个游戏就像一个池子,有进水口,也有出水口,我们"数据分析师"希望进水口大,出水口小,然而进水口再大,你不进水,有一天出水口也会让池子干涸,因此控制出水的同时,也要想办法做好进水口,也就是如何做好新玩家的分析,预测,挽留。因为留下的新玩家有一天也会变成我们定义的老用户,进而变成我们要设法挽留的老用户。每个玩家在游戏中都是有生命周期的,流失分析的目的是拉长这个周期的同时,将价值发挥到最大。

CDA学员免费下载查看报告全文:2026全球数智化人才指数报告【CDA数据科学研究院】.pdf

数据分析咨询请扫描二维码

若不方便扫码,搜微信号:CDAshujufenxi

在大数据技术飞速迭代、数字营销竞争日趋激烈的今天,“精准触达、高效转化、成本可控”已成为企业营销的核心诉求。传统广告投放 ...

2026-04-24在游戏行业竞争白热化的当下,用户流失已成为制约游戏生命周期、影响营收增长的核心痛点。据行业报告显示,2024年移动游戏平均次 ...

2026-04-24 很多业务负责人开会常说“我们要数据驱动”,最后却变成“看哪张报表数据多就用哪个”,往往因为缺乏一套结构性的方法去搭建 ...

2026-04-24在Power BI数据可视化分析中,切片器是连接用户与数据的核心交互工具,其核心价值在于帮助使用者快速筛选目标数据、聚焦分析重点 ...

2026-04-23以数为据,以析促优——数据分析结果指导临床技术改进的实践路径 临床技术是医疗服务的核心载体,其水平直接决定患者诊疗效果、 ...

2026-04-23很多数据分析师每天盯着GMV、DAU、转化率,但当被问到“哪些指标是所有企业都需要的”“哪些指标是因行业而异的”“北极星指标和 ...

2026-04-23近日,由 CDA 数据科学研究院重磅发布的《2026 全球数智化人才指数报告》,被中国教育科学研究院官方账号正式收录, ...

2026-04-22在数字化时代,客户每一次点击、浏览、下单、咨询等行为,都在传递其潜在需求与决策倾向——这些按时间顺序串联的行为轨迹,构成 ...

2026-04-22数据是数据分析、建模与业务决策的核心基石,而“数据清洗”作为数据预处理的核心环节,是打通数据从“原始杂乱”到“干净可用” ...

2026-04-22 很多数据分析师每天盯着GMV、转化率、DAU等数字看,但当被问到“什么是指标”“指标和维度有什么区别”“如何搭建一套完整的 ...

2026-04-22在数据分析与业务决策中,数据并非静止不变的数值,而是始终处于动态波动之中——股市收盘价的每日涨跌、企业月度销售额的起伏、 ...

2026-04-21在数据分析领域,当研究涉及多个自变量与多个因变量之间的复杂关联时,多变量一般线性分析(Multivariate General Linear Analys ...

2026-04-21很多数据分析师精通描述性统计,能熟练计算均值、中位数、标准差,但当被问到“用500个样本如何推断10万用户的真实满意度”“这 ...

2026-04-21在数据处理与分析的全流程中,日期数据是贯穿业务场景的核心维度之一——无论是业务报表统计、用户行为追踪,还是风控规则落地、 ...

2026-04-20在机器学习建模全流程中,特征工程是连接原始数据与模型效果的关键环节,而特征重要性分析则是特征工程的“灵魂”——它不仅能帮 ...

2026-04-20很多数据分析师沉迷于复杂的机器学习算法,却忽略了数据分析最基础也最核心的能力——描述性统计。事实上,80%的商业分析问题, ...

2026-04-20在数字化时代,数据已成为企业决策的核心驱动力,数据分析与数据挖掘作为解锁数据价值的关键手段,广泛应用于互联网、金融、医疗 ...

2026-04-17在数据处理、后端开发、报表生成与自动化脚本中,将 SQL 查询结果转换为字符串是一项高频且实用的操作。无论是拼接多行数据为逗 ...

2026-04-17面对一份上万行的销售明细表,要快速回答“哪个地区卖得最好”“哪款产品增长最快”“不同客户类型的购买力如何”——这些看似复 ...

2026-04-17数据分析师一天的工作,80% 的时间围绕表格结构数据展开。从一张销售明细表到一份完整的分析报告,表格结构数据贯穿始终。但你真 ...

2026-04-16