京公网安备 11010802034615号

经营许可证编号:京B2-20210330

京公网安备 11010802034615号

经营许可证编号:京B2-20210330

Python增量循环删除MySQL表数据的方法

有一业务数据库,使用MySQL 5.5版本,每天会写入大量数据,需要不定期将多表中“指定时期前“的数据进行删除,在SQL SERVER中很容易实现,写几个WHILE循环就搞定,虽然MySQL中也存在类似功能,怎奈自己不精通,于是采用Python来实现

话不多少,上脚本:

# coding: utf-8

import MySQLdb

import time

# delete config

DELETE_DATETIME = '2016-08-31 23:59:59'

DELETE_ROWS = 10000

EXEC_DETAIL_FILE = 'exec_detail.txt'

SLEEP_SECOND_PER_BATCH = 0.5

DATETIME_FORMAT = '%Y-%m-%d %X'

# MySQL Connection Config

Default_MySQL_Host = 'localhost'

Default_MySQL_Port = 3358

Default_MySQL_User = "root"

Default_MySQL_Password = 'roo@01239876'

Default_MySQL_Charset = "utf8"

Default_MySQL_Connect_TimeOut = 120

Default_Database_Name = 'testdb001'

def get_time_string(dt_time):

"""

获取指定格式的时间字符串

:param dt_time: 要转换成字符串的时间

:return: 返回指定格式的字符串

"""

global DATETIME_FORMAT

return time.strftime(DATETIME_FORMAT, dt_time)

def print_info(message):

"""

将message输出到控制台,并将message写入到日志文件

:param message: 要输出的字符串

:return: 无返回

"""

print(message)

global EXEC_DETAIL_FILE

new_message = get_time_string(time.localtime()) + chr(13) + str(message)

write_file(EXEC_DETAIL_FILE, new_message)

def write_file(file_path, message):

"""

将传入的message追加写入到file_path指定的文件中

请先创建文件所在的目录

:param file_path: 要写入的文件路径

:param message: 要写入的信息

:return:

"""

file_handle = open(file_path, 'a')

file_handle.writelines(message)

# 追加一个换行以方便浏览

file_handle.writelines(chr(13))

file_handle.close()

def get_mysql_connection():

"""

根据默认配置返回数据库连接

:return: 数据库连接

"""

conn = MySQLdb.connect(

host=Default_MySQL_Host,

port=Default_MySQL_Port,

user=Default_MySQL_User,

passwd=Default_MySQL_Password,

connect_timeout=Default_MySQL_Connect_TimeOut,

charset=Default_MySQL_Charset,

db=Default_Database_Name

)

return conn

def mysql_exec(sql_script, sql_param=None):

"""

执行传入的脚本,返回影响行数

:param sql_script:

:param sql_param:

:return: 脚本最后一条语句执行影响行数

"""

try:

conn = get_mysql_connection()

print_info("在服务器{0}上执行脚本:{1}".format(

conn.get_host_info(), sql_script))

cursor = conn.cursor()

if sql_param is not None:

cursor.execute(sql_script, sql_param)

row_count = cursor.rowcount

else:

cursor.execute(sql_script)

row_count = cursor.rowcount

conn.commit()

cursor.close()

conn.close()

except Exception, e:

print_info("execute exception:" + str(e))

row_count = 0

return row_count

def mysql_query(sql_script, sql_param=None):

"""

执行传入的SQL脚本,并返回查询结果

:param sql_script:

:param sql_param:

:return: 返回SQL查询结果

"""

try:

conn = get_mysql_connection()

print_info("在服务器{0}上执行脚本:{1}".format(

conn.get_host_info(), sql_script))

cursor = conn.cursor()

if sql_param != '':

cursor.execute(sql_script, sql_param)

else:

cursor.execute(sql_script)

exec_result = cursor.fetchall()

cursor.close()

conn.close()

return exec_result

except Exception, e:

print_info("execute exception:" + str(e))

def get_id_range(table_name):

"""

按照传入的表获取要删除数据最大ID、最小ID、删除总行数

:param table_name: 要删除的表

:return: 返回要删除数据最大ID、最小ID、删除总行数

"""

global DELETE_DATETIME

sql_script = """

SELECT

MAX(ID) AS MAX_ID,

MIN(ID) AS MIN_ID,

COUNT(1) AS Total_Count

FROM {0}

WHERE create_time <='{1}';

""".format(table_name, DELETE_DATETIME)

query_result = mysql_query(sql_script=sql_script, sql_param=None)

max_id, min_id, total_count = query_result[0]

# 此处有一坑,可能出现total_count不为0 但是max_id 和min_id 为None的情况

# 因此判断max_id和min_id 是否为NULL

if (max_id is None) or (min_id is None):

max_id, min_id, total_count = 0, 0, 0

return max_id, min_id, total_count

def delete_data(table_name):

max_id, min_id, total_count = get_id_range(table_name)

temp_id = min_id

while temp_id <= max_id:

sql_script = """

DELETE FROM {0}

WHERE id <= {1}

and id >= {2}

AND create_time <='{3}';

""".format(table_name, temp_id + DELETE_ROWS, temp_id, DELETE_DATETIME)

temp_id += DELETE_ROWS

print(sql_script)

row_count = mysql_exec(sql_script)

print_info("影响行数:{0}".format(row_count))

current_percent = (temp_id - min_id) * 1.0 / (max_id - min_id)

print_info("当前进度{0}/{1},剩余{2},进度为{3}%".format(temp_id, max_id, max_id - temp_id, "%.2f" % current_percent))

time.sleep(SLEEP_SECOND_PER_BATCH)

print_info("当前表{0}已无需要删除的数据".format(table_name))

delete_data('TB001')

delete_data('TB002')

delete_data('TB003')

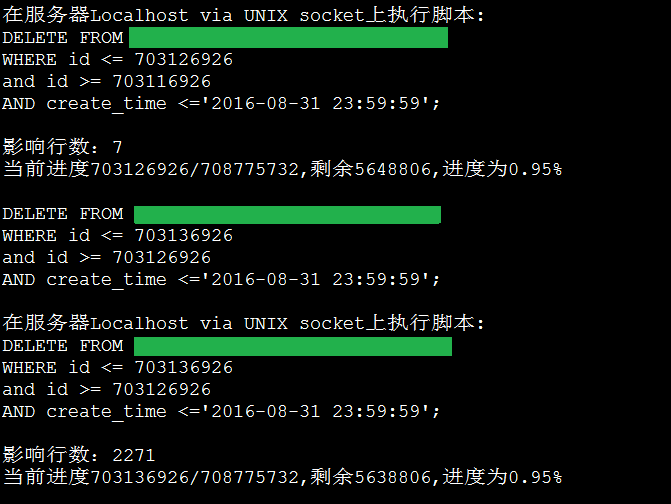

执行效果:

实现原理:

由于表存在自增ID,于是给我们增量循环删除的机会,查找出满足删除条件的最大值ID和最小值ID,然后按ID 依次递增,每次小范围内(如10000条)进行删除。

实现优点:

实现“小斧子砍大柴”的效果,事务小,对线上影响较小,打印出当前处理到的“ID”,可以随时关闭,稍微修改下代码便可以从该ID开始,方便。

实现不足:

为防止主从延迟太高,采用每次删除SLEEP1秒的方式,相对比较糙,最好的方式应该是周期扫描这条复制链路,根据延迟调整SLEEP的周期,反正都脚本化,再智能化点又何妨!

数据分析咨询请扫描二维码

若不方便扫码,搜微信号:CDAshujufenxi

【核心关键词】贷款、报表、课程、专业、建模、缺失值、营销、互联网、银行、办公自动化、数据分析、数据预处理、特征工程、贷 ...

2026-06-05在数据库数据查询、业务报表统计、多表关联分析中,LEFT JOIN左连接是使用率最高的SQL关联查询语句。其核心特性是保留左表全部数 ...

2026-06-05 很多数据分析师能熟练地写SQL、做透视表、算描述性统计,但当被问到“如何预测用户流失概率”“如何归因销量下滑的关键因素 ...

2026-06-05任何一款产品从诞生、普及到最终退出市场,都会遵循一套固定的发展规律,这就是产品生命周期理论。在市场竞争日益激烈、产品迭代 ...

2026-06-04在Excel数据分析、办公统计、业务报表制作场景中,数据透视表是数据汇总、分类统计、快速复盘的核心工具,能够高效完成海量原始 ...

2026-06-04 很多数据分析师拿到数据就开始清洗、建模,但当被问到“这批数据属于什么类型——结构化还是非结构化?分类变量还是数值变量 ...

2026-06-04在问卷调查与社会科学数据分析中,卡方检验是最常用、最基础的非参数检验方法,广泛应用于市场调研、用户分析、行为统计、满意度 ...

2026-06-03【核心关键词】贷款、报表、课程、专业、建模、缺失值、营销、互联网、银行、办公自动化、数据分析、数据预处理、特征工程、贷 ...

2026-06-03 很多数据分析师画过趋势图、做过业绩预测,但当被问到“这个月销售额增长20%,到底是长期趋势自然增长,还是促销活动的短期 ...

2026-06-03逻辑回归是数据分析、机器学习、统计建模中应用最广泛的二分类预测模型,常用于风险判断、行为预测、归因分析等场景。在SPSS、Py ...

2026-06-02数字经济时代,市场竞争日趋同质化,用户消费需求愈发个性化、多元化,传统依托经验、粗放式、广撒网的营销模式弊端日益凸显。长 ...

2026-06-02 很多数据分析师做过按月份的销售额趋势图,画过按天的流量折线图,但当被问到“时间序列和普通数据有什么本质区别”“季节性 ...

2026-06-02在市场竞争日趋饱和、用户需求不断细分的当下,企业创业创新、产品迭代与市场拓展不再依赖经验决策,而是需要系统化、工具化的商 ...

2026-06-01【核心关键词】调度、岗位、数据库、企业、报表、培训、程序、数据分析、数据加工、业务部门、企业数据、调度工具、业务指标、 ...

2026-06-01 很多数据分析师能熟练地计算指标、搭建标签体系,但当被问到“画像到底在解决什么问题”“画像和标签是什么关系”“画像如何 ...

2026-06-01在数据统计分析、数据清洗、异常值识别与数据分布研究中,箱型图是最直观、高效、专业的可视化分析工具。相较于柱状图、折线图仅 ...

2026-05-29Tkinter是Python内置的标准GUI图形界面库,具备无需额外安装、调用简单、兼容性强、轻量化高效等优势,是Python快速开发桌面小程 ...

2026-05-29 很多分析师在设计标签时思路清晰,但真到落地环节却面临“数据在手,不知如何转化为可用标签”的困境:或因加工方式选择不当 ...

2026-05-29【核心关键词】大数据、经理、专业、金融、客户、传统、建模、数据产品、互联网金融、产品经理、数据分析、金融行业、数据模型 ...

2026-05-28 很多分析师每天和数据打交道,但当被问到“标签是什么”“标签和指标有什么区别”“标签体系如何设计”时,却常常答不上来。 ...

2026-05-28