京公网安备 11010802034615号

经营许可证编号:京B2-20210330

京公网安备 11010802034615号

经营许可证编号:京B2-20210330

R语言中大型数据集的回归

众所周知,R语言是一个依赖于内存的软件,就是说一般情况下,数据集都会被整个地复制到内存之中再被处理。对于小型或者中型的数据集,这样处理当然没有什么问题。但是对于大型的数据集,例如网上抓取的金融类型时间序列数据或者一些日志数据,这样做就有很多因为内存不足导致的问题了。

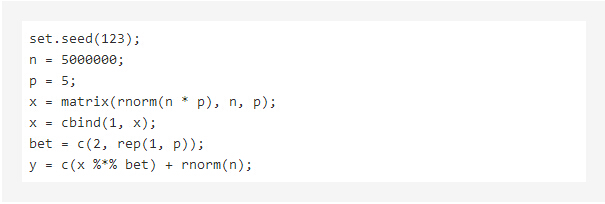

这里是一个具体的例子。在 R 中输入如下代码,创建一个叫 x 的矩阵和叫 y 的向量。

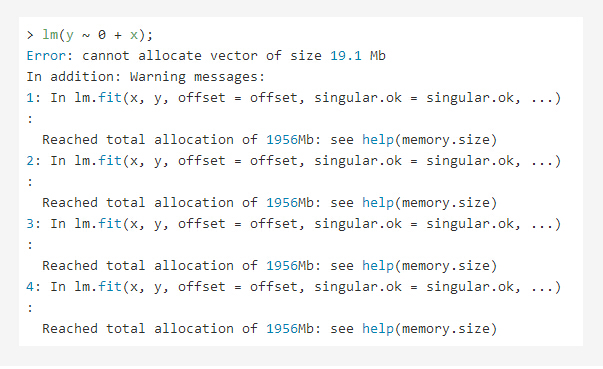

如果用内置的 lm 函数对 x 和 y 进行回归分析,就有可能出现如下错误(当然,也有可能因为内存足够而运行成功):

本文代码运行的电脑的配置是:

CPU: Intel Core i5-2410M @ 2.30 GHz

Memory: 2GB

OS: Windows 7 64-bit

R: 2.13.1 32-bit

在 R 中,每一个 numeric 数 占用 8 Bytes,所以可以估算到 x 和 y 只是占用 5000000 7 8 / 1024 ^ 2 Bytes = 267 MB,离运行的电脑的内存 2 GB 差很远。问题在于,运行 lm() 函数会生成很多额外的变量塞满内存。比如说拟合值和残差。

如果我们只是关心回归的系数,我们可以直接用矩阵运算来计算 β^ :

在本文运行的计算机中,这个命令成功执行, 而且很快(0.6秒)(我使用了一个优化版本的 Rblas, 下载)。然而,如果样本变得更加大了,这个矩阵运算也会变得不可用。可以估算出,如果样本大小为 2GB / 7 / 8 Bytes = 38347922 ,x 和 y 自己就会占用了全部内存,更不要说其他计算过程中出现的临时变量了。

怎么破?

一个方法就是用数据库来避免占用大量内存,并且直接在数据库中执行 SQL 语句等。数据库使用硬盘来保存数据,并且执行 SQL 语句时只是占用少量内存,所以基本上不用过于担心内存占用。不过有得有失,要更加关注完成任务所占用的时间。

R 支持很多数据库,其中 SQLite 是最轻量级和简单的。有一个 RSQLite 包,允许用户在 R 中对 SQLite 进行操作。这些操作包括了对 SQLite 数据库进行读写,执行 SQL 语句和在 R 中获取执行结果。所以,如果我们能够把需要的算法“翻译”到 SQL 语句版本,数据集的大小只受限于硬盘的大小和我们能够接受的执行时间。

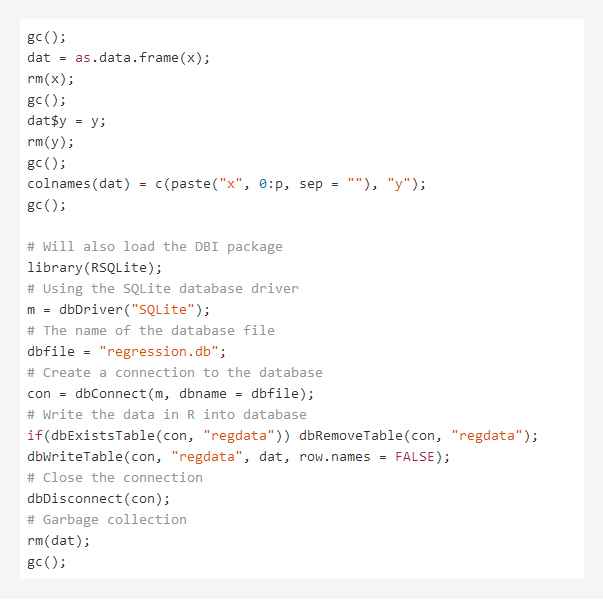

采用上面的那个例子,我这里说明我们会怎样用数据库和 SQL 语句来对数据集进行回归。首先我们要把数据塞到硬盘上面。

上述代码有很多 rm() 和 gc() ,函数,这些函数是用来移除没有用的临时变量和释放内存。当代码运行完毕的时候,你就会发现在你的工作空间中有一个 320M 左右的 regression.db 文件。然后就是最重要的一步了:把回归的算法转化为 SQL。

我们有

β^=(X′X)−1X′y

而且,无论 n 有多大,X′X 和 X′y 的大小总是 (p+1)∗(p+1) 。如果变量不是很多,R 处理矩阵逆和矩阵乘法还是很轻松的,所以我们的主要目标是用 SQL 来计算 X′X 和 X′y 。

由于 X=(x0,x1,…,xp),所以 X′X 可以表达为:

$$%

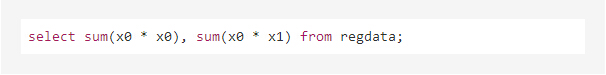

而每一个矩阵元素都可以用 SQL 来计算,比如说:

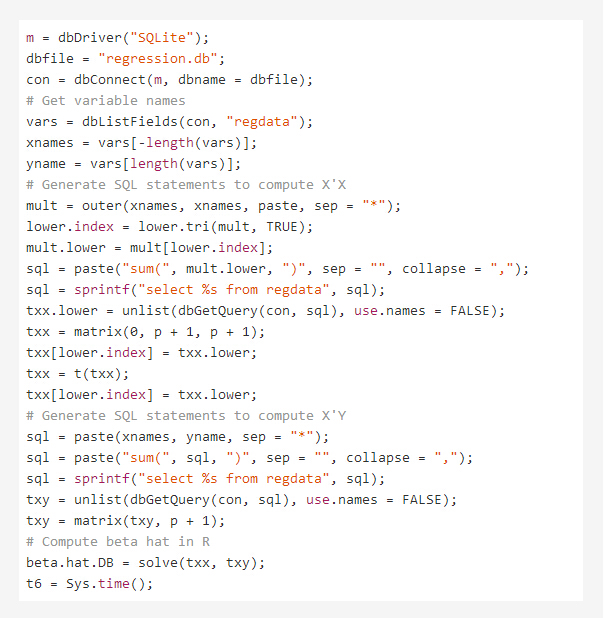

我们可以用 R 来生成 SQL 语句,然后把语句发送到 SQLite :

可以看出差别是舍入误差导致的。

以上计算用了大约 17 秒,远远超出矩阵运算的时间。不过它也几乎没有占用额外的内存空间。实际上我们采用了“时间换空间”的策略。此外,你可能还发现,我们可以通过多个对数据库的连接同步地计算 sum(x0*x0), sum(x0*x1), ..., sum(x5*x5) ,所以如果你有一个多核的服务器(而且硬盘足够快),你还可以通过适当的安排大量地减少运行时间。

数据分析咨询请扫描二维码

若不方便扫码,搜微信号:CDAshujufenxi

【核心关键词】贷款、报表、课程、专业、建模、缺失值、营销、互联网、银行、办公自动化、数据分析、数据预处理、特征工程、贷 ...

2026-06-05在数据库数据查询、业务报表统计、多表关联分析中,LEFT JOIN左连接是使用率最高的SQL关联查询语句。其核心特性是保留左表全部数 ...

2026-06-05 很多数据分析师能熟练地写SQL、做透视表、算描述性统计,但当被问到“如何预测用户流失概率”“如何归因销量下滑的关键因素 ...

2026-06-05任何一款产品从诞生、普及到最终退出市场,都会遵循一套固定的发展规律,这就是产品生命周期理论。在市场竞争日益激烈、产品迭代 ...

2026-06-04在Excel数据分析、办公统计、业务报表制作场景中,数据透视表是数据汇总、分类统计、快速复盘的核心工具,能够高效完成海量原始 ...

2026-06-04 很多数据分析师拿到数据就开始清洗、建模,但当被问到“这批数据属于什么类型——结构化还是非结构化?分类变量还是数值变量 ...

2026-06-04在问卷调查与社会科学数据分析中,卡方检验是最常用、最基础的非参数检验方法,广泛应用于市场调研、用户分析、行为统计、满意度 ...

2026-06-03【核心关键词】贷款、报表、课程、专业、建模、缺失值、营销、互联网、银行、办公自动化、数据分析、数据预处理、特征工程、贷 ...

2026-06-03 很多数据分析师画过趋势图、做过业绩预测,但当被问到“这个月销售额增长20%,到底是长期趋势自然增长,还是促销活动的短期 ...

2026-06-03逻辑回归是数据分析、机器学习、统计建模中应用最广泛的二分类预测模型,常用于风险判断、行为预测、归因分析等场景。在SPSS、Py ...

2026-06-02数字经济时代,市场竞争日趋同质化,用户消费需求愈发个性化、多元化,传统依托经验、粗放式、广撒网的营销模式弊端日益凸显。长 ...

2026-06-02 很多数据分析师做过按月份的销售额趋势图,画过按天的流量折线图,但当被问到“时间序列和普通数据有什么本质区别”“季节性 ...

2026-06-02在市场竞争日趋饱和、用户需求不断细分的当下,企业创业创新、产品迭代与市场拓展不再依赖经验决策,而是需要系统化、工具化的商 ...

2026-06-01【核心关键词】调度、岗位、数据库、企业、报表、培训、程序、数据分析、数据加工、业务部门、企业数据、调度工具、业务指标、 ...

2026-06-01 很多数据分析师能熟练地计算指标、搭建标签体系,但当被问到“画像到底在解决什么问题”“画像和标签是什么关系”“画像如何 ...

2026-06-01在数据统计分析、数据清洗、异常值识别与数据分布研究中,箱型图是最直观、高效、专业的可视化分析工具。相较于柱状图、折线图仅 ...

2026-05-29Tkinter是Python内置的标准GUI图形界面库,具备无需额外安装、调用简单、兼容性强、轻量化高效等优势,是Python快速开发桌面小程 ...

2026-05-29 很多分析师在设计标签时思路清晰,但真到落地环节却面临“数据在手,不知如何转化为可用标签”的困境:或因加工方式选择不当 ...

2026-05-29【核心关键词】大数据、经理、专业、金融、客户、传统、建模、数据产品、互联网金融、产品经理、数据分析、金融行业、数据模型 ...

2026-05-28 很多分析师每天和数据打交道,但当被问到“标签是什么”“标签和指标有什么区别”“标签体系如何设计”时,却常常答不上来。 ...

2026-05-28